安徽互联网联盟(ahunion.org)主办的站长讲座不知不觉到了第十二期。上期的讲座获得了众多参与站长很高的赞誉也让更多的站长积极的加入到讲座群内来,目前在国内最知名的网站采集软件肯定就似乎火车头采集器(locoy.com)了,火车采集器(LocoySpider)是一个功能强大的数据采集软件.使用它关键词搜索引擎标题采集软件,您可以很容易的从网页上抓取文字,图片,文件等资源.目前是国内使用率最高的网站采集软件,前不久刚推出了2009的最新版,深受广大站长的喜爱。由于该采集器的创始人李进斌正好是安徽老乡,前不久去年底的安徽站长聚会上有过合作,所以李兄很爽快的就答应了老K我来和站长朋友们聊聊,由于李兄是技术出生打字速度不快,所以在算算的一个半小时内说的内容不太多,但是非常精辟,大家看了便明白了,希望能给诸位站长带来帮助。由于讲座主群已满 新到站长可加直播群:47744157进行专题讲座 我们随时会T从来不发言的站长 让更多想学习的站长进来。

一、谈火车头采集器的由来

火车头:我们的这个采集器最早是从05年底开始有这个想法的,当时也是和大家一样,个人站长,添加管理维护网站很辛苦,一篇篇修改复制发布最开始也是接触dede 然后发现他有个外部的c#采集器。不知道有多少人也记得,我的思路基本是从这个dedespider学来的,原来真的不懂什么,到后来学会php和.net,所以只要大家有兴趣,技术上的问题都可以克服,讲到现在的采集,其实采集只能替代站长部分手工的操作。我们不建议大规模得制造垃圾站(全盘得采集复制别人的站点),所以我们现在的软件的功能越做越多,但新用户缺越来越不会用了。

我们现在有一批很忠实的会员,他们一直在靠采集器更新网站。迅速的采集然后百度搜录带来巨大的流量的时代已经不在,站长还是要关注内容,靠采集器采集的数据一样要注意,前期只能做为一个数据填充,可以稍微大的。但时间长了,目标就要把垃圾数据也要变成精品,否则做不长久

二、关于采集网站的经验

火车头:我们现在在更新这个采集器,在数据采集方面也积累了一些经验,增加更多功能以适应新形式下的采集

1.别人经常采的网站不要去采

2.太容易采的网站不要去采

3.不要一次性采集太多,一定要注意后期处理(后面详续)

4.做好关键词,tag的采集分析

5.自己网站要有自己的定位,不采与自己网站无关的内容

6.采集也要有持续性,经常更新,自动采集功能我们也有,但还是建议大家人工也参与一些审核,或定时,乱序发布

后期处理,要想法子做到让搜索引擎那看不出来两片文章的相同,这里面应该有很多SEO高手,那我不献丑了。我说下我们现在实现的功能,大家可以把这些混用,达到改变内容伪原创:

1.给标题。内容分词

2.使用同义词近义词替换,排除敏感词,不同的标签之间数据融合,指如标题内容之间数据的相互替换

3.给文章加上摘要

4.为文章标题等生成拼音地址

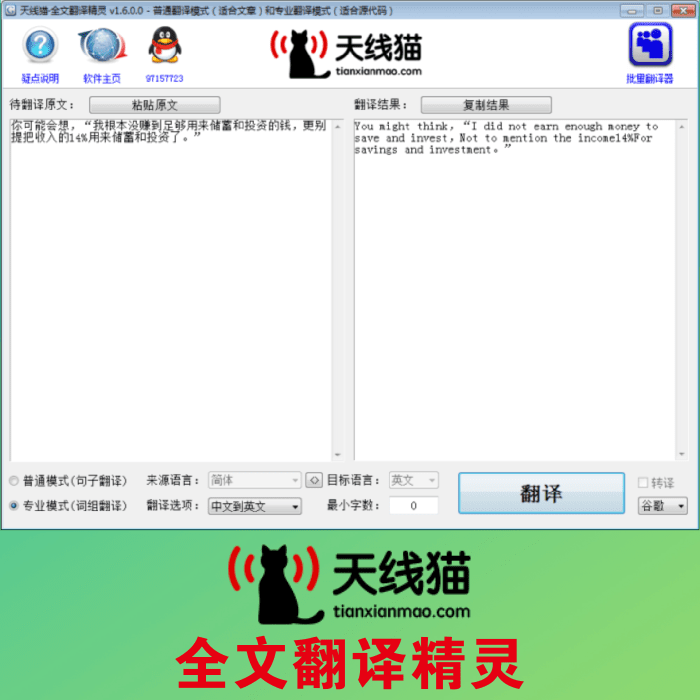

5.采集一些其他编码的网站,我们可以做到简繁体转化,可以采集中文网站翻译成英文(虽然比较垃圾,但应该可以算是原创)

我们也发现,高难度采集的网站一般内容质量都非常好,采集其实有时也是一件很有乐趣的事情,需要你学习一些采集相关的知识。

描述采集三、关于防采集的方法

火车头:下面讲一些主要的防采集方法。可以说是攻防对战吧。打开一个网页实际就是一个Http请求浏览器。百度蜘蛛,小到我们的采集器使用的都是一个原理,模拟http请求,所以我们同样能模拟出浏览器。百度蜘蛛出来所以绝对的防采集根本不存在,只是难度的高低。或者你认为搜索引擎的搜录也无所谓了。你可以用一些非常强大的activex,flash,全图片文字的形式,这个我们无能为力。

普通的防采集方法有

1、来源判断

2、登录信息判断 Cookie

3、请求次数判断。如一段时间内请求多少关键词搜索引擎标题采集软件,非常规操作则封IP

4、发送方式判断 POST GET 使用JS,Ajax等请求内容

举例:

1.2不用说了,论坛,下载站等关键词搜索引擎标题采集软件。。

3、一些大网站,需要配置服务器,单纯靠脚本判断资源消耗比较大

4、如一些招聘站,asp.net的分页,Web2.0站的ajax请求内容

当然我们后面还发现一些杀手锏,今天第一次在这里给大家公布出来~~ 有优质内容需要防采集的朋友可以考虑试下

1、网页默认deflate压缩输出(gzip容易一点,容易解压) 我们普通的浏览器和baidu支持识别gzip,deflate输出内容

2、网页内容不定时 \0 内容自动截断,这两点基本可以防主大部分主流软件采集及web采集程序了~

今天主要想要表达的一点,大家在做站时一定要注意技术的提高,比如我们里面有后期外部php及.net接口处理采集数据。或者干脆你自己做一个发布时的接口程序自己入库。我们伪原创做得再好,一样有非常多的会员使用,那样又不原创了,采集一样需要技术,只有你通过采集器获得了没有多少人有的数据,你才是唯一了。可能是我最为技术型人的一个通病,谢谢大家!

互动环节

问:您刚才提到对采集有屏蔽,那对搜索引擎呢

答:采集和百度爬虫是一模一样的原理 还有浏览器也是一样的 所以没有绝对的屏蔽,相反还会影响客户体验,你可以做一些不影响客户体验和搜索引擎搜录 而提高采集难度的尝试

问:你刚才讲的是网页内容采集,有没有针对匹配关键词的指定字段的高速采集,比如采集所有带”IDC“的网页的邮箱和电话号码?用过一些,速度很慢,而且数据量明显太少。

答:我们不做这样批量的工具,其实比如做论坛发帖机之类的实现起来道理一样,也很容易,其实实现起来也是可以,只是有更多的一些人工操作 ,我们里面有 正则匹配。。也就是你要的这种单一工具把这种正则都集成在里面了。而我们需要用户自己去写

问:采集的复杂度应该就在这吧?页面规则的不规则性和多变性?

答:在软件里面设置能够匹配多种模板的正则表达式,一样可以采集到多模板的网站,所谓“道高一尺,魔高一丈”。

问:火车头,能不能说一下怎么把phpcms的文章模块下的第一级栏目显示出来啊?

答:用的是 07 还是08版 07版有一个终极栏目的属性 如果是,就不显示。

问:火车头,你觉得哪个CMS比较好用,你给大家推荐一个你最钟意的CMS系统吧。

答:我现在是对phpcms更熟悉一些。选择一个适合自己的就够了。研究透一个。

问:有个采集工具 海纳 号称不要编写采集规则,不知道有没有同学研究过,想请教其原理?

答:你说的这个是内容主体识别的范畴了。也做过,但只对一些新闻网站识别得比较好 ,这是一个自动匹配形式的工具,就像百度新闻一样,能自动匹配到正文数据。对大数据量的提取有好处。但精度相对低点点,因为人工不可控。

问:2008 版本能平滑升级到 2009吗?我是免费用户,呵呵。

答:软件升级:请运行程序目录下的updateto2009.exe进行升级.支持3.2sp5及2008版到2009版的升级,支持所有用户

问:请问伪原创的问题怎么处理呢?

答:我们伪原创做得再好,一样有非常多的会员使用,那样又不原创了,采集一样需要技术,只有你通过采集器获得了没有多少人有的数据,你才是唯一了。比如我们有同义词替换功能,这个词库就需要最好你自己去扩充一个属于自己的伪原创。 使用同义词近义词替换,排除敏感词,不同的标签之间数据融合,指如标题内容之间数据的相互替换给标题。内容分词。为文章标题等生成拼音地址 给文章加上摘要。采集一些其他编码的网站,我们可以做到简繁体转化,可以采集中文网站翻译成英文(虽然比较垃圾,但应该可以算是原创)网民,默认的我们能够自动识别网页的编码。但可能也会有出错的时候,这时候你需要在任务第四页手工定义一下,比如是gb2312还是utf8等等。

文章地址:https://www.tianxianmao.com/article/seo/twzdcjyfcj.html